Inhaltsverzeichnis

- Was ist eine statistische Auswertung?

- Deskriptive Statistik: Daten beschreiben

- Inferenzstatistik: Von Daten auf Allgemeines schließen

- Skalenniveaus: Der Schlüssel zur richtigen Auswertung

- Werkzeuge der deskriptiven Statistik

- Schritt-für-Schritt: Statistische Auswertung für Anfänger

- Häufige Fehler und Herausforderungen

- Software im Vergleich

- Statistische Auswertung in verschiedenen Branchen

- Zusammenfassung & praktische Tipps

- FAQ

Die statistische Auswertung ist ein essenzielles Werkzeug, um aus Daten sinnvolle Informationen abzuleiten. Ob in wissenschaftlichen Arbeiten (Auswertung Fragebogen Statistik), Marktforschung oder industriellen Anwendungen – die Fähigkeit, Daten systematisch zu analysieren, ist gefragter denn je. Das Handelsblatt titelt hierzu: „Schnell jenseits der 100.000 Euro verdienen".

Dieser Leitfaden vermittelt Anfängern die Grundlagen der statistischen Auswertung, zeigt den Unterschied zwischen beschreibender und interpretierender Statistik und liefert praxisnahe Beispiele für die Anwendung. Es gibt auch die Möglichkeit, die statistische Auswertung machen zu lassen — gerne helfen wir Ihnen hierbei.

Starten Sie jetzt Ihr Projekt! Kontaktieren Sie uns für eine individuelle Beratung – schnell, unkompliziert und maßgeschneidert.

Jetzt Kontakt aufnehmenWas ist eine statistische Auswertung?

Statistische Daten auswerten bedeutet, komplexe Informationen verständlich und nutzbar zu machen. Wer Daten richtig analysiert, erkennt Zusammenhänge und trifft fundierte Entscheidungen. Mit modernen Tools wie Excel, SPSS oder R gelingt die Datenanalyse effizient und präzise.

Statistik ist die Wissenschaft, die sich mit der Sammlung, Analyse, Interpretation und Präsentation von Daten befasst. Sie wird grob in zwei Hauptbereiche unterteilt: die deskriptive Statistik, die Daten beschreibt, und die inferenzielle Statistik, die Rückschlüsse auf größere Zusammenhänge ermöglicht.

Deskriptive Statistik: Daten beschreiben

Die deskriptive Statistik beschäftigt sich mit der Beschreibung von Daten. Ziel ist es, komplexe Datensätze in einfache und verständliche Formate zu überführen.

Lageparameter

Sie beschreiben, wo sich die „Zentren" eines Datensatzes befinden:

- Mittelwert: Der Durchschnitt aller Werte. Beispiel: Bei 10, 15, 20 ist der Mittelwert (10+15+20) / 3 = 15.

- Median: Der mittlere Wert in einer sortierten Liste. Beispiel: In 5, 10, 15, 20, 25 ist der Median 15.

- Modus: Der am häufigsten vorkommende Wert. Beispiel: In 2, 3, 3, 4, 5 ist der Modus 3.

Streuungsparameter

- Varianz: Mittelwert der quadrierten Abweichungen vom Mittelwert. Beispiel: Bei 10, 20, 30 beträgt der Mittelwert 20. Die Abweichungen sind −10, 0, +10; quadriert 100, 0, 100 → Varianz = 66,67.

- Standardabweichung: Die Quadratwurzel der Varianz. Im obigen Beispiel: √66,67 ≈ 8,16.

Verteilungsmaße

- Schiefe: Zeigt ob eine Verteilung asymmetrisch ist. Positive Schiefe = langer Schwanz nach rechts (z. B. Einkommen). Negative Schiefe = Schwanz zieht sich nach links.

- Kurtosis: Beschreibt wie spitz oder flach eine Verteilung ist. Hohe Kurtosis = schmaler, spitzer Gipfel mit dicken Schwänzen.

Inferenzstatistik: Von Daten auf Allgemeines schließen

Die inferenzielle Statistik – auch induktive oder beurteilende Statistik genannt – geht einen Schritt weiter und versucht, mit Wahrscheinlichkeitsmodellen Aussagen über eine Grundgesamtheit zu treffen.

Hypothesenbildung

Die Nullhypothese (H0) sagt, dass es keinen Effekt in der Population gibt. Die Alternativhypothese (H1) unterstützt die These, dass es einen Effekt innerhalb der Population gibt. Forschende versuchen, mithilfe statistischer Tests für eine der beiden Hypothesen zu entscheiden.

Wichtige statistische Tests

- t-Test: Vergleich von Mittelwerten zweier Gruppen

- Chi-Quadrat-Test: Zusammenhang zwischen kategorialen Variablen

- ANOVA (Analysis of Variance): Vergleich von mehr als zwei Gruppen

Zu den statistischen Schlüsselkonzepten gehören das Signifikanzniveau, der P-Wert und Konfidenzintervalle. Weitere Blogartikel findest du hier.

Skalenniveaus: Der Schlüssel zur richtigen Auswertung

Das Skalenniveau einer Variablen bestimmt, welche statistischen Methoden sinnvoll angewendet werden können:

| Skalenniveau | Eigenschaften | Beispiele | Geeignete Tests |

|---|---|---|---|

| Nominalskala | Kategorien ohne Reihenfolge | Geschlecht, Farben | Chi-Quadrat-Test, Häufigkeiten |

| Ordinalskala | Kategorien mit Reihenfolge, ungleiche Abstände | Schulnoten, Ränge | Mann-Whitney-U, Kruskal-Wallis |

| Intervallskala | Gleiche Abstände, kein absoluter Nullpunkt | Temperatur in °C, Kalenderjahre | t-Test, ANOVA |

| Verhältnisskala | Gleiche Abstände + absoluter Nullpunkt | Gewicht, Größe, Einkommen | Regression, alle parametrischen Tests |

Werkzeuge der deskriptiven Statistik

Tabellen

Häufigkeitstabellen zeigen, wie oft bestimmte Werte in den Daten vorkommen. Kreuztabellen bieten die Möglichkeit, zwei Variablen gleichzeitig darzustellen, um potenzielle Zusammenhänge zu erkennen.

Diagramme

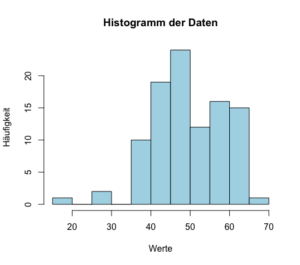

- Histogramme: Für kontinuierliche Daten — zeigen die Häufigkeit von Werten in bestimmten Intervallen.

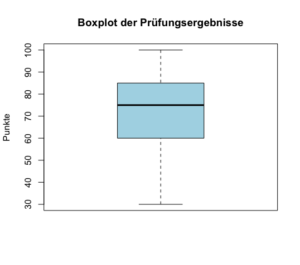

- Boxplots: Zeigen Median, Interquartilsabstand und Ausreißer auf einen Blick.

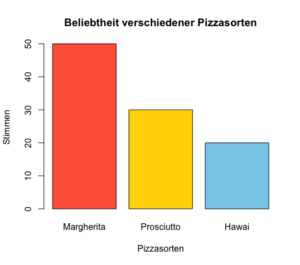

- Balkendiagramme: Für kategoriale Variablen — zeigen die Häufigkeit jeder Kategorie.

Schritt-für-Schritt: Statistische Auswertung für Anfänger

- Daten vorbereiten: Datenbereinigung — fehlende Werte und Ausreißer identifizieren. Formatierung sicherstellen: Variablen im richtigen Format, Skalenniveaus korrekt definiert.

- Kennzahlen berechnen: Lage- und Streuungsmaße bestimmen (Mittelwert, Median, Standardabweichung). Grafische Darstellungen erstellen — Histogramme, Boxplots, Streudiagramme.

- Ergebnisse interpretieren: Muster erkennen — Auffälligkeiten, Trends, Zusammenhänge identifizieren. Hypothesen formulieren und durch statistische Tests überprüfen.

Praxisbeispiel: Statistische Auswertung einer Kundenumfrage

Ein Online-Shop möchte wissen, wie zufrieden seine Kunden sind und ob sich die Zufriedenheit zwischen verschiedenen Altersgruppen unterscheidet. So sieht die Auswertung in der Praxis aus:

- Datenerhebung: 500 Kunden bewerten verschiedene Aspekte (Lieferzeit, Produktqualität, Preis-Leistungs-Verhältnis) auf einer 5-stufigen Skala. Demografische Daten wie Alter und Geschlecht werden erhoben.

- Datenbereinigung: Unvollständige Antworten werden geprüft. Bei fehlenden Werten unter 5% entfernt, bei größeren Lücken durch Imputation ersetzt.

- Deskriptive Statistik: Berechnung des Mittelwerts pro Aspekt — Lieferzeit: M = 4,2; SD = 0,8. Produktqualität: M = 4,5; SD = 0,7. Preis-Leistung: M = 3,8; SD = 1,1.

- Visualisierung: Boxplots zeigen die Verteilung pro Frage — der breite Streubereich beim Preis-Leistungs-Verhältnis wird sofort sichtbar.

- Hypothesentest: ANOVA prüft ob sich die Zufriedenheit zwischen drei Altersgruppen (18–30, 31–50, 51+) signifikant unterscheidet. Ergebnis: F(2, 497) = 8,42; p = 0,003 — es gibt einen signifikanten Unterschied.

- Post-Hoc-Test: Tukey-HSD zeigt: Die Altersgruppe 51+ ist signifikant zufriedener (p < 0,05) als die Gruppe 18–30.

- Interpretation: Junge Kunden sind kritischer — möglicher Handlungsbedarf bei Marketing oder Produktanpassung für diese Zielgruppe.

Wann braucht man welchen statistischen Test? Eine Entscheidungshilfe

Die Wahl des richtigen Tests ist entscheidend für valide Ergebnisse. Hier eine praktische Übersicht:

| Fragestellung | Empfohlener Test | Voraussetzungen |

|---|---|---|

| Unterschied zwischen 2 Gruppen (metrisch) | t-Test (unabhängig) | Normalverteilung, Varianzhomogenität |

| Unterschied zwischen 2 Messzeitpunkten | t-Test (gepaart) | Normalverteilung der Differenzen |

| Differenz zwischen 3+ Gruppen | ANOVA + Post-Hoc | Normalverteilung, Varianzhomogenität |

| Zusammenhang zweier metrischer Variablen | Pearson-Korrelation | Normalverteilung, lineare Beziehung |

| Zusammenhang ordinaler Variablen | Spearman-Korrelation | Ordinalskala, monotone Beziehung |

| Vorhersage einer Variable durch andere | Regression (linear/logistisch) | Normalverteilung der Residuen |

| Zusammenhang nominaler Variablen | Chi-Quadrat-Test | Erwartete Häufigkeit > 5 pro Zelle |

| Nicht-normalverteilte Daten, 2 Gruppen | Mann-Whitney-U | Ordinal- oder Intervallskala |

| Nicht-normalverteilte Daten, 3+ Gruppen | Kruskal-Wallis | Ordinal- oder Intervallskala |

Häufige Fehler und Herausforderungen

- Überinterpretation von Zufallsergebnissen: Scheinbare Zusammenhänge in kleinen Stichproben können rein zufällig sein.

- Verwendung ungeeigneter Tests: Z. B. t-Test für unabhängige Stichproben anwenden, obwohl ein gepaarter t-Test nötig wäre.

- Fehlende Berücksichtigung von Skalenniveaus: Nominale Daten mit Methoden für metrische Daten analysieren führt zu sinnlosen Ergebnissen.

Software im Vergleich

Wir empfehlen die Verwendung von R, da die Software kostenlos ist und nahezu alles bei statistischen Auswertungen umsetzen kann. Lesen Sie auch unseren Artikel zur statistischen Auswertung mit SPSS.

| Software | Vorteile | Nachteile |

|---|---|---|

| Excel | Intuitiv und weit verbreitet | Begrenzte Funktionen für komplexe Analysen |

| R | Leistungsstark und flexibel, kostenlos | Erfordert Programmierkenntnisse |

| SPSS | Benutzerfreundlich für Anfänger | Kostenpflichtig |

| Python | Vielseitig und skalierbar | Höhere Einstiegshürde |

Starten Sie jetzt Ihr Projekt! Kontaktieren Sie uns für eine individuelle Beratung – schnell, unkompliziert und maßgeschneidert.

Jetzt Kontakt aufnehmenStatistische Auswertung in verschiedenen Branchen

Statistische Auswertungen sind branchenübergreifend unverzichtbar. Hier ein Überblick über typische Anwendungen:

Wissenschaft & Forschung

An Universitäten und Forschungseinrichtungen sind statistische Auswertungen die Grundlage für jede Publikation. Bachelor-, Master- und Doktorarbeiten verlangen meist einen empirischen Teil mit korrekt durchgeführten Hypothesentests. Besonders in den Sozialwissenschaften, Psychologie und Medizin sind SPSS-Auswertungen Standard. Wichtige Aspekte: korrektes Studiendesign, ausreichende Stichprobengröße (Power-Analyse), passende Methodenwahl und transparente Berichterstattung nach APA-Standards.

Medizin & Klinische Studien

In klinischen Studien werden Wirksamkeit und Sicherheit von Therapien statistisch geprüft — meist mit randomisiert-kontrollierten Studien (RCT). Häufig verwendete Methoden: Survival-Analysen (Kaplan-Meier), logistische Regression für Erfolgswahrscheinlichkeiten und ANOVA für Gruppenvergleiche. Die FDA und EMA verlangen vorab definierte statistische Analysepläne (SAP) — nachträgliche Anpassungen sind nicht erlaubt.

Marktforschung & Marketing

Unternehmen analysieren Kundenverhalten, Markenwahrnehmung und Kampagnen-Erfolg. A/B-Tests prüfen welche Variante einer Anzeige besser konvertiert. Conjoint-Analysen identifizieren welche Produktmerkmale Kunden am wichtigsten sind. Cluster-Analysen segmentieren Zielgruppen nach Verhalten oder Präferenzen — die Basis für personalisiertes Marketing.

Wirtschaft & Finanzen

Banken nutzen statistische Modelle für Kreditrisiko-Bewertung (Scoring), Versicherungen für Schadensprognosen. Zeitreihenanalysen (ARIMA) und Volatilitätsmodelle (GARCH) prognostizieren Aktienkurse. In der Ökonometrie werden multiple Regressionsmodelle verwendet um wirtschaftliche Zusammenhänge zu untersuchen — meist mit STATA oder R.

Industrie & Qualitätskontrolle

In der Produktion überwachen Statistical Process Control (SPC) Diagramme die Produktqualität in Echtzeit. Six-Sigma-Methoden minimieren Fehlerquoten durch systematische Datenanalyse. ANOVA-Verfahren testen welche Produktionsfaktoren die Qualität beeinflussen — die Basis für Optimierung.

Zusammenfassung & praktische Tipps

Die statistische Auswertung ist ein mächtiges Werkzeug, das mit der richtigen Herangehensweise auch für Anfänger verständlich wird. Mit einer soliden Grundlage in deskriptiver und inferenzieller Statistik, dem Wissen über Skalenniveaus und den passenden Tools steht einer erfolgreichen Auswertung einer Statistik nichts im Weg.

Die wichtigsten Erfolgsfaktoren auf einen Blick:

- Klare Forschungsfrage: Bevor Sie Daten erheben, definieren Sie genau was Sie wissen wollen

- Passendes Studiendesign: Querschnitt vs. Längsschnitt, experimentell vs. korrelativ

- Ausreichende Stichprobengröße: Mit Power-Analysen vorab kalkulieren (G*Power ist hier kostenlos)

- Skalenniveau beachten: Das bestimmt welche Tests überhaupt zulässig sind

- Voraussetzungen prüfen: Normalverteilung, Varianzhomogenität, Unabhängigkeit

- Effektstärke berichten: Nicht nur p-Werte — sondern auch wie stark der Effekt wirklich ist (Cohen's d, η², r)

- Transparenz: Alle Schritte dokumentieren, damit andere die Analyse nachvollziehen können

- Im Zweifel Hilfe holen: Eine fehlerhafte Auswertung kann Wochen Arbeit zerstören

FAQ – Häufige Fragen zur statistischen Auswertung

Eine statistische Auswertung ist der Prozess, bei dem Daten analysiert werden, um Muster, Zusammenhänge oder Unterschiede zu erkennen. Sie umfasst das Erheben, Bereinigen, Beschreiben und Interpretieren von Daten mithilfe statistischer Methoden. Ziel ist es, aus rohen Zahlen sinnvolle und verwertbare Erkenntnisse zu gewinnen.

Die deskriptive Statistik beschreibt vorhandene Daten durch Kennzahlen wie Mittelwert, Median und Standardabweichung — sie macht keine Aussagen über eine größere Gesamtheit.

Die inferenzielle Statistik zieht Rückschlüsse von einer Stichprobe auf eine größere Grundgesamtheit. Sie prüft Hypothesen mit statistischen Tests und gibt Wahrscheinlichkeitsaussagen über die Richtigkeit der Schlussfolgerungen.

Für Anfänger ohne Programmierkenntnisse empfehlen wir:

- Excel: Guter Einstiegspunkt für einfache Analysen

- SPSS: Benutzerfreundliche Menüführung, keine Programmierkenntnisse nötig

Für komplexere Analysen sind R und Python besser geeignet — erfordern aber etwas Einarbeitung in die Programmierung.

Der richtige Test hängt von drei Faktoren ab:

- Fragestellung: Gruppenvergleich, Zusammenhang oder Vorhersage?

- Skalenniveau: Nominal, ordinal oder metrisch?

- Voraussetzungen: Normalverteilung? Unabhängigkeit der Gruppen?

Faustregel: Nominaldaten → Chi-Quadrat. Ordinaldaten → Mann-Whitney-U. Metrische Daten mit Normalverteilung → t-Test oder ANOVA. Ohne Normalverteilung → nicht-parametrische Tests.

Eine statistische Auswertung ist aussagekräftig wenn:

- Die Daten valide sind (messen was gemessen werden soll)

- Die Daten reliabel sind (konsistente Messung)

- Die Stichprobengröße ausreichend ist

- Die passenden Methoden für das Skalenniveau gewählt wurden

- Die Ergebnisse im Kontext interpretiert werden

- Nominaldaten: Chi-Quadrat-Test, Fisher's Exact Test

- Ordinaldaten: Mann-Whitney-U-Test, Kruskal-Wallis-Test

- Metrische Daten: t-Test, ANOVA, Regression

- Zeitreihen: ARIMA-Modelle, Trendanalysen

- Kleine Stichproben: Nicht-parametrische Tests wie Wilcoxon-Test

- Zusammenhänge: Korrelation (Pearson/Spearman), Regression

- Gruppenvergleiche: t-Test, ANOVA, Chi-Quadrat-Test

- Überinterpretation von Zufallsergebnissen in kleinen Stichproben

- Verwendung falscher Tests (z. B. t-Test für abhängige statt unabhängige Stichproben)

- Skalenniveaus ignorieren und Mittelwerte für Nominaldaten berechnen

- Fehlende Werte unbehandelt lassen

- p-Wert als einziges Entscheidungskriterium verwenden ohne Effektstärke zu berichten